最近在看HashMap源码,对于扩容因子=0.75感到很费解,为什么在用了75%的容量的时候就要进行扩容呢?数组中明明还有25%的空间没有使用。为什么不等到数组几乎满了(扩容因子=0.95)的时候才进行扩容?扩容因子=0.95和...

”松泊分布 hashmap扩容因子 java“ 的搜索结果

hashmap扩容与三个值有关,当前容量,负载因子,已插入的元素总数,即元素总数>当前容量x负载因子时进行扩容。 以上为一般情况扩容(调用resize),由于hashmap采用的是lazy初始化的策略,会在第一次put的...

java hashmap 扩容因子为什么是0.75,官方给出的解释

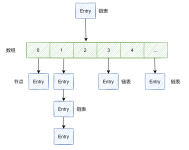

本文介绍Java的HashMap是如何扩容的。

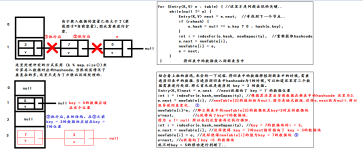

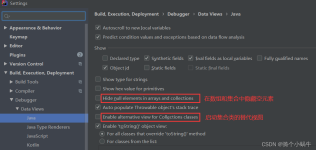

HashMap属于比较常用的数据结构了,面试过程中也经常会被问到,本篇就知识点,展开问答式分析,重点聊聊hash冲突、扩容死链、容量为2的n次方、1.7和1.8之间的区别等问题~

HashMap: public HashMap(int initialCapacity, floatloadFactor) {//初始容量不能<0if (initialCapacity < 0)throw new IllegalArgumentException("Illegal initial capacity: " +initialCapacity)...

一:对于HashMap的扩容因子为什么是0.75,需要先了解泊松分布,因为该值是通过泊松分布计算出来的 二:泊松分布 适用于单位时间、单位面积内,单位长度内等相互独立的随机事件发生的概率。简单来说即用来求...

提示:文章先作为初版,等后续时间充足后,补充更深的内容。

HashMap是如何进行扩容的

关于HashMap扩容机制

标签: java

public class HashMap<K,V>extends AbstractMap<K,V>implements Map<K,V>, Cloneable, Serializable{ // 默认的初始容量(容量为HashMap中桶的数目)是16,且实际容量必须是2的整数次幂。 ...

【HashMap扩容机制】

标签: java

1.如果HashMap的大小超过了负载因子(load factor)定义的容量,怎么办? 默认的负载因子大小为0.75,也就是说,当一个map填满了75%的bucket时候,和其它集合类(如ArrayList等)一样,将会创建原来HashMap大小的两倍的...

当HashMap中的元素个数超过数组大小(数组长度)*loadFactor(负载因子)时,就会进行数组扩容,loadFactor的默认值(DEFAULT_LOAD_FACTOR)是0.75,这是一个折中的取值。也就是说,默认情况下,数组大小为16,那么当...

HashMap在容量超过负载因子所定义的容量后,就会扩容,将HashMap的大小扩大为原来的两倍。 判断当前数组是否为空,为空则是初始化操作 如果旧数组长度大于等于最大容量MAXIMUM_CAPACITY=1 <<30,则将...

Java 7 中Hashmap扩容机制一、什么时候扩容:网上总结的会有很多,但大多都总结的不够完整或者不够准确。大多数可能值说了满足我下面条件一的情况。扩容必须满足两个条件:1、 存放新值的时候当前已有元素的个数必须...

通过扩容,可以使得元素分布到更多的桶中,降低哈希冲突的概率,提高查询效率。加载因子是哈希表在其容量自动增加之前可以达到多满的一种尺度,它衡量的是一个散列表的空间的使用程度,负载因子越大表示散列表的装填...

Java HashMap说明此文档所介绍的HashMap是基于JDK1.8之后的。此文受到网上很多其他Java生态爱好者文章的影响,写此文的目的是系统的概括下HashMap,并把一些优秀文章的脉络连接起来起到目录作用。在此感谢优秀文章...

详细介绍了Java中HashMap的扩容机制,讨论了何时触发扩容,以及扩容的具体过程。让我们更深入理解Java中HashMap的工作原理,提高编程效率。

1. 扩容因子为什么是0.75? static final float DEFAULT_LOAD_FACTOR = 0.75f; 源码中给出的解释如下:负载因子是0.75的时候,空间利用率比较高,而且避免了相当多的Hash冲突,使得底层的链表或者是红黑树的高度...

HashMap的扩容机制

标签: java

HashMap的扩容机制在jdk1.7和jdk1.8有什么不同

【hashmap 扩容机制 0.75怎么算出来的】

HashMap 的扩容阈值通常设为 0.75。这是因为,当 HashMap 中的条目数量超过容量的 3/4 时,散列表就可能变得过于稠密,这样就会增加查找的时间复杂度。为了避免这种情况,当 HashMap 的条目数量超过阈值时,它就会...

推荐文章

- Android 编译so文件 MP4V2_android下编译mp4v2-程序员宅基地

- 通讯录Contact_02_contact文件内容-程序员宅基地

- Qt笔记(四十二)之QZXing的编译 配置 使用_qzxingfilterrunnable error:-程序员宅基地

- 关于画图软件Dia打开程序始终为英文界面的问题-程序员宅基地

- OpenCV从入门到精通实战(二)——文档OCR识别(tesseract)-程序员宅基地

- 详解avcodec_receive_packet 11_avcodec_receive_packet eagain-程序员宅基地

- OpenGL SuperBible 7th源码编译记录_superbible7-media github-程序员宅基地

- Wireshark简单使用-程序员宅基地

- MXNet 粗糙的使用指南_iou loss mxnet-程序员宅基地

- iOS对ipa包进行代码混淆《二》 ---代码混淆_ipa包混淆-程序员宅基地